10 min de lecture

On a testé Apple Intelligence : écriture, photos, emojis... Que valent les nouvelles fonctions de l'iPhone ?

Les nouveaux outils d'intelligence artificielle d'Apple lancés avec la mise à jour iOS 18.4 aident à améliorer la rédaction des contenus, la génération d'images, la retouche des photos et à gérer les notifications. Pour un premier bilan contrasté.

Apple Intelligence est disponible en France dans une première version

Crédit : Apple

Je m'abonne à la newsletter « Infos »

C'est l'heure du premier bilan pour les nouvelles fonctions dopées à l'intelligence artificielle d'Apple. Neuf mois après sa présentation en juin 2024 et quatre mois après son arrivée aux États-Unis, la suite Apple Intelligence est disponible en France depuis le lundi 31 mars et le déploiement de la mise à jour logicielle vers iOS 18.4. Seuls les iPhone les plus récents sont éligibles, car ces outils nécessitent une grande puissance de calcul et un espace de stockage important (plus de 7 giga-octets sont requis) pour pouvoir être exécutés sur les appareils. Outre les iPhone 16 et 15 Pro, les iPad équipés des puces M ou A17 Pro et les Mac avec une puce M sont compatibles, mais pas les ordinateurs plus anciens animés par une puce Intel.

L'arrivée de cette mise à jour est une étape importante dans la stratégie d'Apple dans l'intelligence artificielle. Développée en réponse au narratif qui s'est imposé dans le monde des technologies depuis l'avènement de ChatGPT fin 2022, cette suite logicielle s'appuie sur les capacités de l'IA générative pour ouvrir de nouvelles possibilités aux utilisateurs des produits de l'entreprise. Le fabricant de l'iPhone l'a intégrée dans ses principales applications, comme Messages, Mails, Notes ou Photos, pour améliorer la rédaction des contenus, faciliter la retouche d'images et la génération d'emojis, résumer les informations importantes, perfectionner la reconnaissance visuelle et rendre plus naturelles les interactions avec l'assistant Siri.

Avec ce lancement, Apple rattrape une partie de son retard sur ses rivaux dans le secteur très disputé de l'IA générative. OpenAI, Google, Samsung, Microsoft, Meta et même Amazon ont investi des milliards de dollars pour développer leurs propres modèles de langage et se positionner dans la bataille de l'IA. Certaines fonctionnalités qui arrivent seulement sur les iPhone sont déjà bien connues des adeptes de smartphones Samsung ou Google sous Android. Une plainte a même été déposée aux États-Unis pour publicité mensongère du fait des spots publicitaires diffusés par Apple qui auraient laissé croire à des consommateurs qu'Apple Intelligence et la nouvelle version de Siri seraient disponibles dès la sortie de l'iPhone 16 l'automne dernier.

Une IA volontairement bridée pour plus de confidentialité

Cette première version d'Apple Intelligence doit toutefois être considérée à la lumière de l'approche singulière adoptée par Apple en matière de confidentialité. La firme se base sur un traitement local de son intelligence artificielle, sans passer par le cloud, quand ses concurrents n'hésitent pas à entraîner leurs modèles sur des jeux de données extérieurs et les perfectionnent sur des profils utilisateurs personnalisés.

Développés en interne sur les propres puces du groupe, les modèles génératifs de Cupertino sont conçus pour fonctionner directement sur ses appareils, sans faire transiter de données vers des serveurs tiers. Cela leur permet de bénéficier des sécurités et garanties qui font la réputation du groupe américain en matière de confidentialité. Et lorsqu'une tâche complexe nécessite plus de ressources, les données sont dirigées automatiquement, de façon anonymisée, vers le "private cloud compute", des serveurs chiffrés répondant aux mêmes exigences de sécurité.

Cet arbitrage est particulièrement limitant pour Apple. L'IA a besoin de s'entraîner pour s'améliorer. Plus elle peut le faire sur des bases de données importantes, plus vite elle peut progresser. Le choix de recourir à des modèles exécutés en local va en quelque sorte à l'encontre de la promesse d'ultra-personnalisation mise en avant par la plupart des marques qui font la promotion de l'IA générative. Il implique également la conception de serveurs dédiés adaptés aux régulations locales, dans l'Union européenne notamment. Cela a en outre exclu de la mise à jour la majorité des appareils en circulation de la marque qui ne disposent pas de la puissance de calcul minimale pour exécuter ces opérations directement, mais auraient pu fournir des réponses en passant par le cloud.

Un nouveau Siri encore en développement

Dans ce contexte, la première mouture d'Apple Intelligence ne prétend pas "changer la vie" des utilisateurs, comme s'avançaient pourtant les dirigeants d'Apple lors de sa présentation il y a neuf mois. Ces nouveaux outils se présentent davantage comme une surcouche logicielle appliquée à certaines applications que comme un remaniement en profondeur de l'architecture d'iOS. Ils donnent un aperçu de la façon dont l'IA générative peut faire évoluer la façon dont on interagit avec son téléphone. Il s'agit d'ailleurs d'une version "bêta" du logiciel, qui est appelée à s'améliorer au fil des mises à jour.

Le changement le plus visible est la nouvelle version de Siri. Symbole des ambitions d'Apple dans ce nouveau domaine, l'assistant est désormais flanqué d'un halo lumineux multicolore lorsqu'on fait appel à lui. On peut toujours le solliciter à la voix, mais plus forcément besoin de dire la formule consacrée "Dis Siri" pour le voir s'illuminer sur les bords de l'écran. Un long appui sur le bouton latéral de l'iPhone suffit. Il est aussi possible de lui parler en tapant du texte en appuyant deux fois en bas de l'écran.

Le nouveau design de Siri

Crédit : Apple

D'après Apple, ce Siri 2.0 est en capacité d'avoir une compréhension approfondie du langage et de traiter des requêtes plus complexes pour des interactions pus naturelles. De fait, l'assistant se montre plus à l'aise pour capter les intentions de son interlocuteur. Il arrive à suivre les demandes, même en trébuchant sur les mots, sans avoir à énoncer explicitement les requêtes sous-jacentes. Mais s'il s'avère efficace pour régler une alarme, un minuteur, sonder la météo ou écrire des SMS, des tâches simples, il affiche vite ses limites pour le reste. Par exemple, n'espérez pas lui demander de lancer une playlist spécifique dans votre application musicale en même temps que votre réveil le matin, il se contentera de créer une alarme du nom de la playlist en question.

Même rafraîchi, Siri est loin d'être l'assistant autonome et omniscient, capable de chercher des informations dans l'historique de votre iPhone ou de réserver un billet d'avion à partir d'un simple prompt, vendu par Apple lors de la présentation d'Apple Intelligence. Cupertino a admis que la refonte de son architecture prendrait encore un certain temps. En attendant, Apple a noué un accord avec OpenAI pour que Siri puisse passer le relai à ChatGPT lorsqu'il n'est pas capable de répondre. ChatGPT peut chercher sur Internet et user de sa propre puissance de calcul pour apporter une réponse plus complète. Cette fonction est gratuite et il est possible de lier son compte OpenAI pour conserver l'historique de ses recherches et enlever les limitations.

Les données collectées par ChatGPT bénéficient d'un traitement particulier : Apple assure que seuls la requête et d'éventuels documents joints sont transmis à OpenAI, sans lien avec le compte Apple de l'usager. Et OpenAI ne peut pas utiliser ces informations pour entraîner ses modèles. À l'avenir, Apple n'exclut pas d'intégrer d'autres intelligences artificielles, telles que Google Gemini ou Perplexity, pour laisser la possibilité à ses utilisateurs de basculer d'un modèle à l'autre en fonction de leurs besoins. Mais la concurrence ne l'attend pas : Samsung a déjà connecté de nombreuses applications à Google Gemini pour permettre à l'IA de ses smartphones Galaxy S25, de réaliser des actions qui combinent plusieurs sources d'informations dans le cadre d'une même requête. Par exemple, pour chercher un restaurant et le partager à un ami ou retrouver les photos de vos dernières vacances et les publier sur les réseaux sociaux.

Des aides à l'écriture plutôt utiles, des résumés de notifications à peaufiner

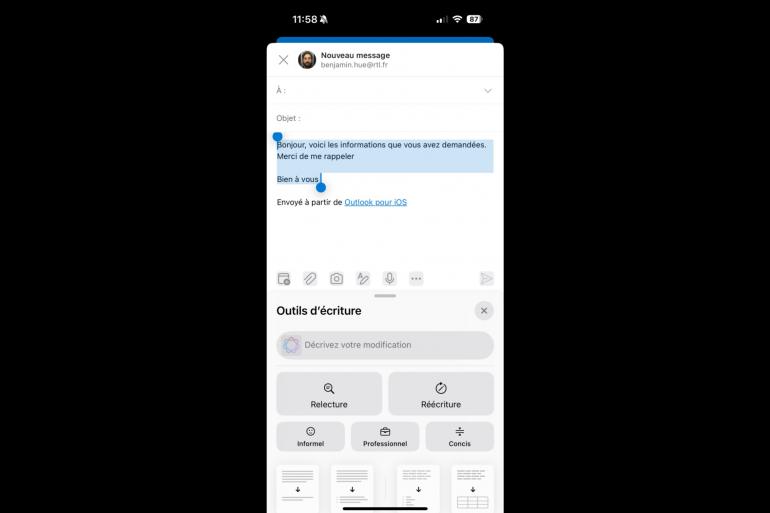

Apple Intelligence propose ensuite une série d'outils "d'aide à l'écriture", permettant d'améliorer les textes dans de nombreuses applications de l'iPhone comme Mails, Messages, Notes, mais aussi Gmail, Outlook ou Google Docs. Il suffit de sélectionner tout ou partie d'un mail ou d'un SMS et d'appuyer sur le bouton "Outils d'écriture" pour accéder à une palette d'options visant à rendre le propos plus professionnel ou informel. On peut aussi écrire directement la consigne souhaitée, par exemple "rends ce texte plus amical" ou "plus professionnel" ou "rédige un mail à partir de ces informations" et l'IA s'y emploie.

Les outils d'écriture d'Apple Intelligence

Crédit : RTL

Correction de fautes et tri de mails

Les outils d'écriture permettent aussi de rechercher d'éventuelles fautes d'orthographe et de syntaxe dans un texte. Ils peuvent également synthétiser des documents pour en produire un résumé, avec des points-clés et des listes, et faire des tableaux à partir de données brutes. Apple n'a pas à rougir de la concurrence sur ce plan : le service se montre plutôt efficace, même si l'utilisation de ces outils peut s'avérer fastidieuse lorsqu'il s'agit de sélectionner le texte à modifier avec le doigt sur l'écran de son téléphone.

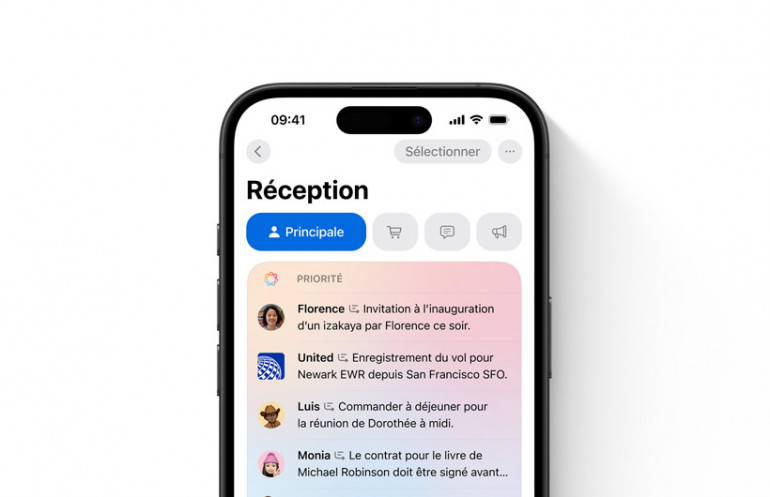

Dans l'application Mails, Apple Intelligence entend vous faire gagner du temps en proposant des résumés synthétisant le contenu des courriels dès leur intitulé. Si la fiabilité est encore incertaine lorsque la fonction se risque à résumer une chaîne de plusieurs emails, elle permet de se faire une idée plus précise en un coup d'œil de ce qui mérite notre attention ou non parmi les nombreuses sollicitations reçues au cours de la journée.

Les résumés de mails

Crédit : Apple

Organisation des notifications

Apple applique aussi cette synthèse aux notifications. Cela permet de condenser une pile d'alertes en deux lignes en ne conservant que les informations essentielles. Mais la réalisation est encore assez imprécise, a fortiori en français, l'IA d'Apple étant peu au fait de tous les rudiments de notre langue. Des déformations et des contresens sont à prévoir. Apple a d'ailleurs bridé la fonctionnalité après quelques ratés pendant les tests d'Apple Intelligence ces dernières semaines. Heureusement, il est possible de choisir à quel type d'alertes les résumés s'appliquent (médias, réseaux sociaux, finance, etc.) ou de les désactiver. À l'inverse, les résumés proposés par le navigateur Safari sont très efficaces pour retenir l'essentiel d'un article d'un site Web, même en français.

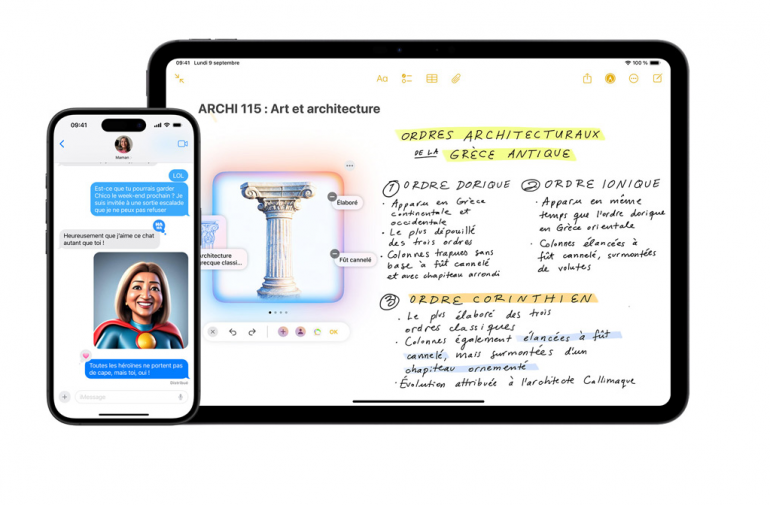

Genmojis, Photos, Playground : des résultats mitigés pour la génération d'images

Apple Intelligence apporte aussi son lot de nouveautés en matière de retouche et de génération d'images. La fonction Genmoji donne la possibilité de créer des emojis à partir d'une brève description pour les réutiliser ensuite dans les conversations en ligne. La fonction permet par exemple de créer un emoji à son image ou à l'effigie d'un proche. Pour l'activer, il faut se rendre dans le clavier de n'importe quelle application de messagerie, dans l'onglet "Genmoji" à côté des emojis classiques. Une fois déterminée la photo dont elle doit s'inspirer, il suffit de décrire l'image souhaitée, par exemple "Maman en supergirl", pour voir apparaître plusieurs propositions de "genmojis". Les résultats sont plutôt convaincants et devraient faire leur effet auprès des proches, même si l'attente peut être plus ou moins longue en fonction des demandes et que quelques plantages ne sont pas à exclure.

Les outils Genmojis et Playground

Crédit : Apple

Une recherche d'images efficace

Apple propose aussi l'application Playground, une sorte de bac à sable créatif, qui permet de créer un dessin ou un avatar à partir d'un croquis réalisé à la main ou de mots-clés, dans différents styles (animé, cartoon, peinture) et avec un thème donné. L'intérêt s'avère assez limité, a fortiori comparé à des outils comme Midjourney et désormais ChatGPT qui délivrent des images ultra-détaillées sur Internet.

Apple Intelligence est aussi mis à contribution dans l'album photos pour rechercher des images à partir de brèves descriptions en langage naturel, par exemple "les dernières vacances en Italie", "le chien près de la piscine", "une facture en Espagne". Le résultat n'est pas toujours probant, mais cela peut aider à mettre la main rapidement sur des images que l'on aurait mis plusieurs minutes à retrouver avec une recherche classique. La fonction peut aussi être utilisée pour créer rapidement un film souvenir à partir d'une instruction.

La recherche naturelle dans l'album Photos

Crédit : Apple

Autre outil inauguré, l'option "Corriger", sorte d'effaceur numérique, qui permet d'effacer un élément indésirable d'une image. Accessible dans les outils d'édition des photos, il détecte automatiquement les contours de la zone sélectionnée et se charge de remplir le vide créé. Si la promesse est intéressante sur le papier, les résultats sont très aléatoires et largement en retrait des performances de la gomme magique proposée par Google, Samsung et les principaux smartphones Android depuis plus d'un an désormais.

La recherche visuelle prometteuse

Enfin, l'un des champs les plus prometteurs explorés par l'IA d'Apple est probablement la recherche visuelle. Baptisée "Visual Intelligence", cette fonctionnalité transforme l'appareil photo de l'iPhone en un moteur de recherche. Il suffit d'un appui prolongé sur le bouton "Caméra control" d'un iPhone 16, ou via le centre de contrôle pour les iPhone 15 Pro, pour lancer l'IA visuelle d'Apple. En prenant une photo, celle-ci va analyser son contenu. Cela permet par exemple de retrouver un vêtement vu sur une photo Instagram ou dans la rue, d'obtenir des informations sur un monument ou de traduire un menu dans un restaurant. Deux boutons permettent aussi de rechercher des informations à partir de l'IA visuelle de ChatGPT, à gauche, ou via son équivalent chez Google, à droite.

- Apple Intelligence est disponible en France avec iOS 18.4 : comment l'activer et quelles sont les nouveautés ?

- Apple Intelligence : pourquoi tous les iPhone et iPad ne sont pas compatibles

- Que changent vraiment les smartphones dopés à l'intelligence artificielle ?

- Apple Intelligence arrivera sur les iPhone en français en avril 2025

- TOUT SAVOIR SUR - iPhone 16 : Apple enfin lancé dans la course à l'intelligence artificielle ?